Equipe Creatify

COMPARTILHAR

NESTE ARTIGO

A maioria dos geradores de vídeo de IA te dão o vale da estranheza - bocas que se movem, olhos que não, corpos que ficam congelados como recortes de papelão. Aurora foi criada para corrigir isso.

Aurora é o modelo de difusão proprietário de Creatify (DiT) para a síntese de avatares guiada por áudio. Dê uma foto e um clipe de áudio, e ele gera um vídeo de qualidade de estúdio daquela pessoa falando, apresentando ou cantando - com expressões faciais sincronizadas, movimentos oculares naturais, respiração e gestos completos da parte superior do corpo. Não é apenas sincronia labial. É uma performance completa.

O modelo já foi integrado ao ElevenLabs, Runware e fal.ai como um dos primeiros modelos de geração de vídeo - um sinal de para onde a geração de vídeo de IA está indo.

Este guia cobre como obter os melhores resultados.

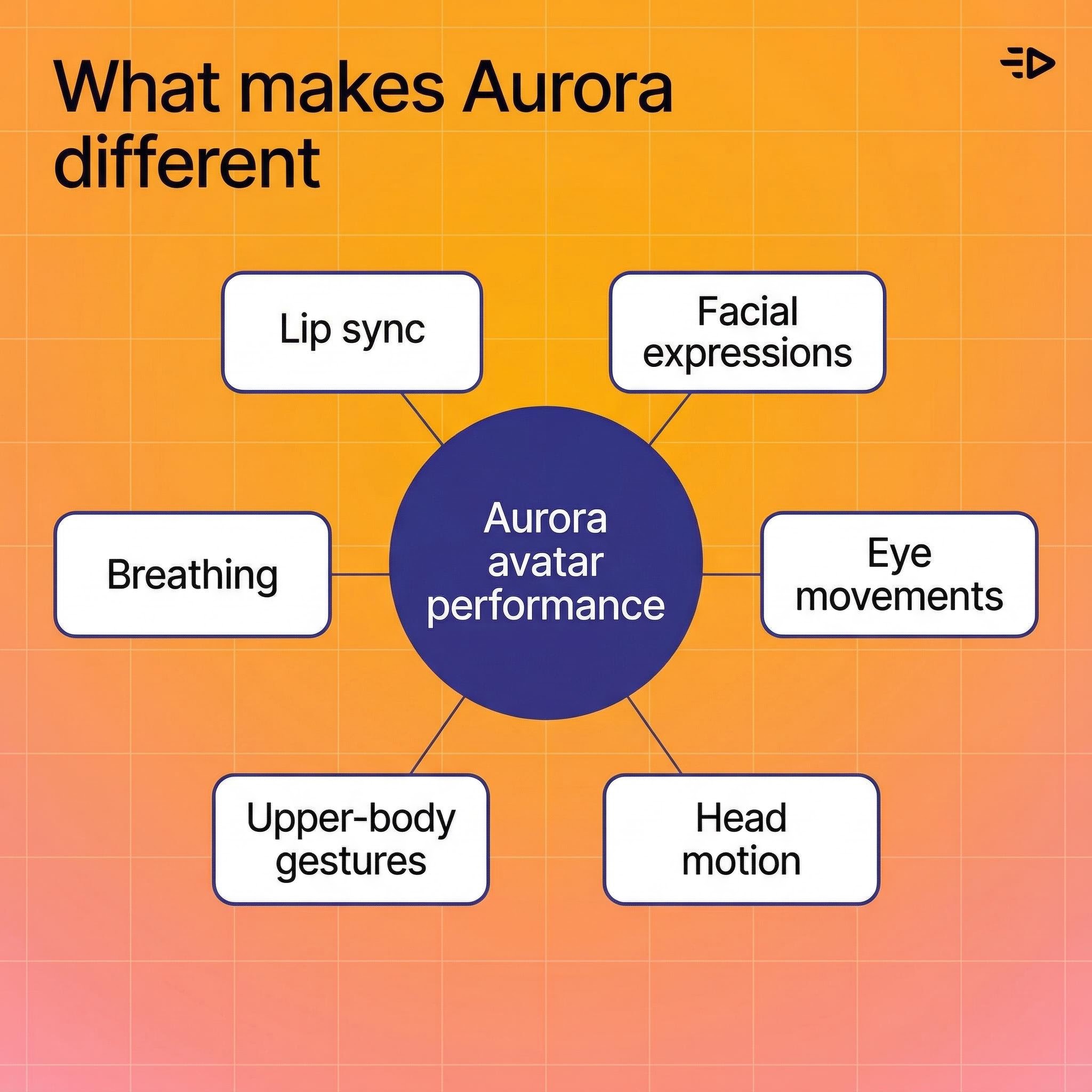

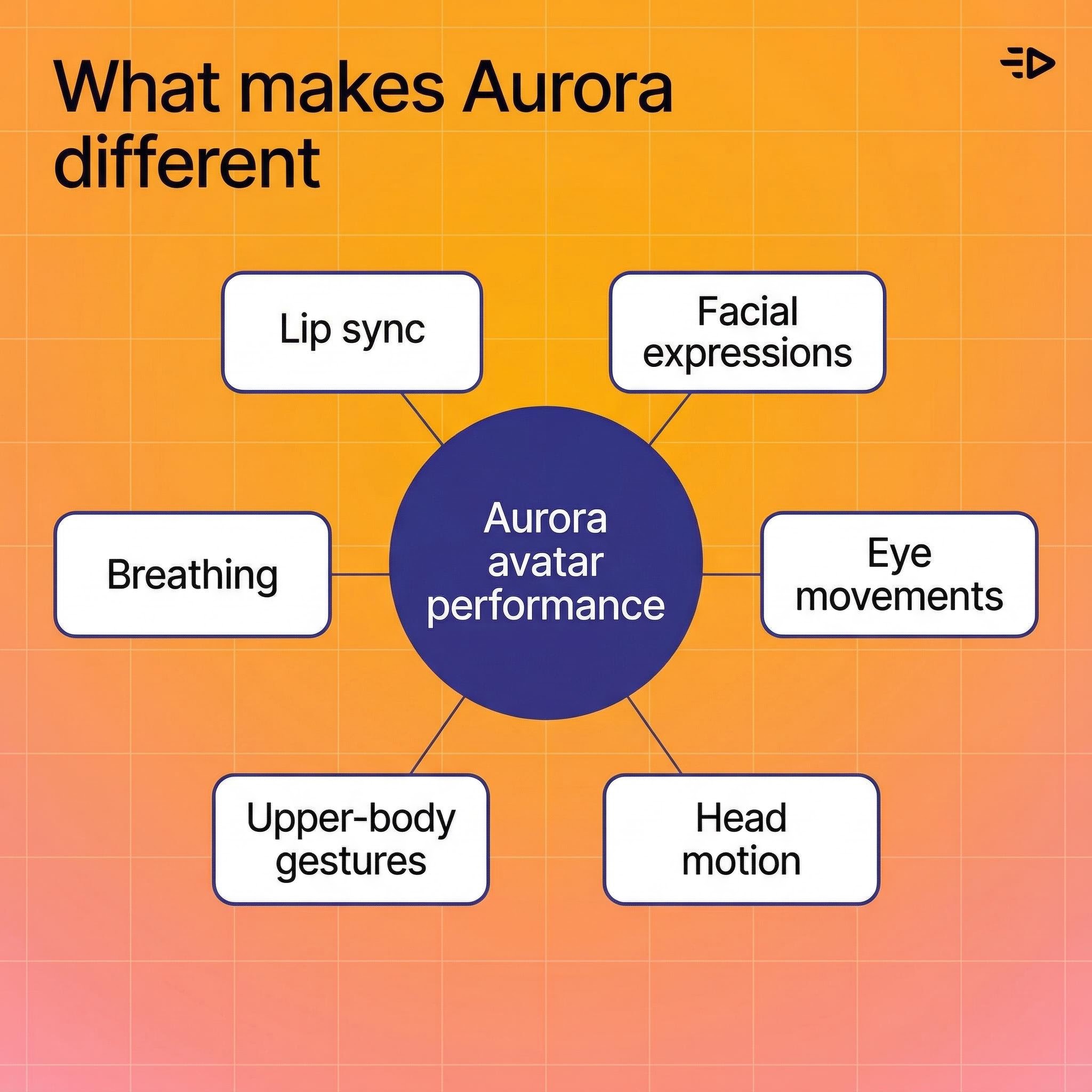

O que torna Aurora diferente

A maioria das ferramentas de cabeças falantes anima a boca e encerra por aí. Aurora trata o avatar como uma pessoa completa, estabelecendo um novo padrão para geração de vídeo de IA realista.

Aqui está o que o modelo realmente produz:

Sincronia labial que acompanha o áudio com precisão, incluindo formas sutis da boca para diferentes fonemas

Expressões faciais que correspondem ao tom vocal e à entrega emocional

Movimentos oculares - piscadas, mudanças de olhar, foco natural

Movimento da cabeça - acenos, inclinações, mudanças sutis de posição

Gestos da parte superior do corpo - movimentos das mãos, mudanças dos ombros, o tipo de movimento natural que faz uma cabeça falante parecer real em vez de robótica

Respiração - movimento do peito entre as frases

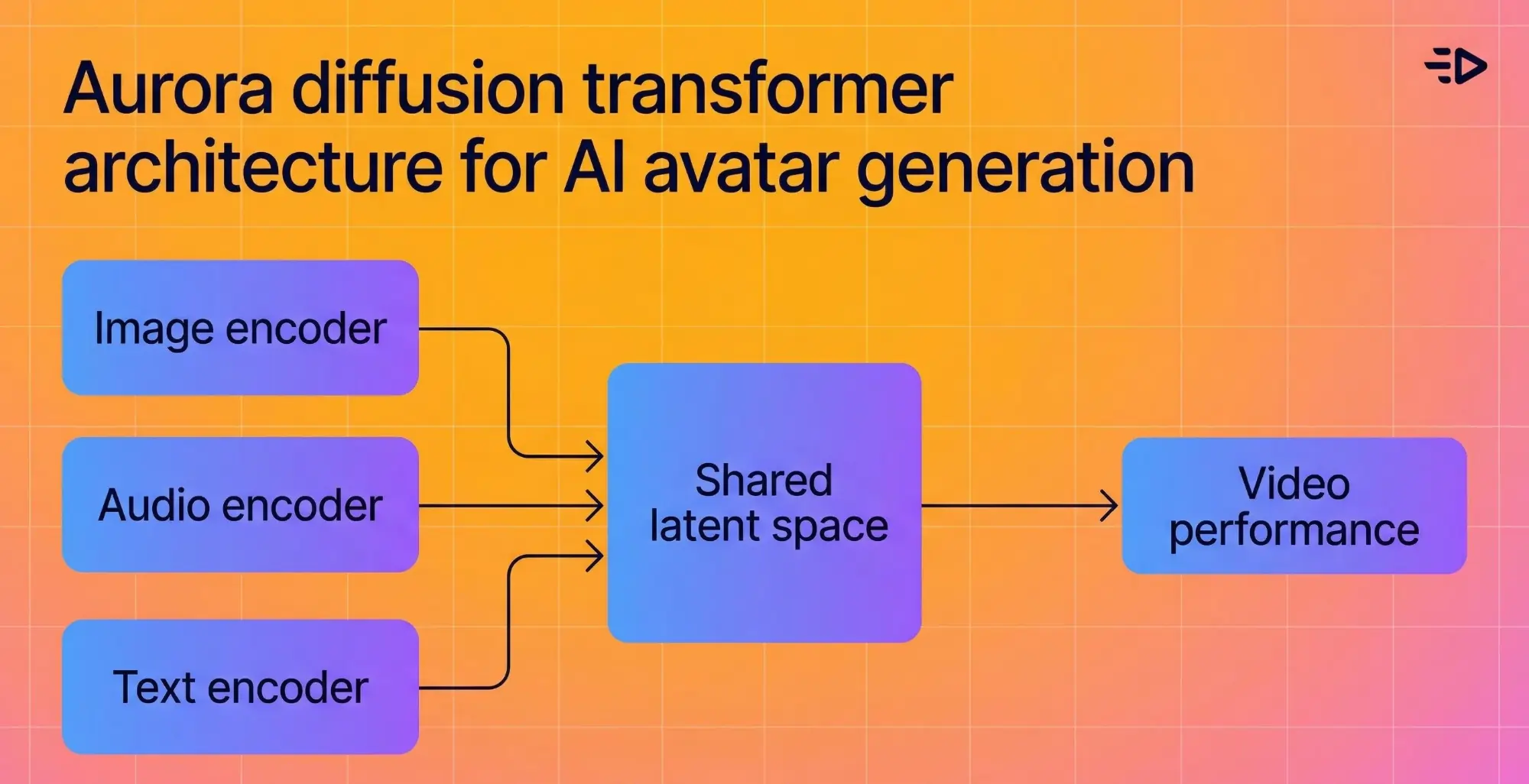

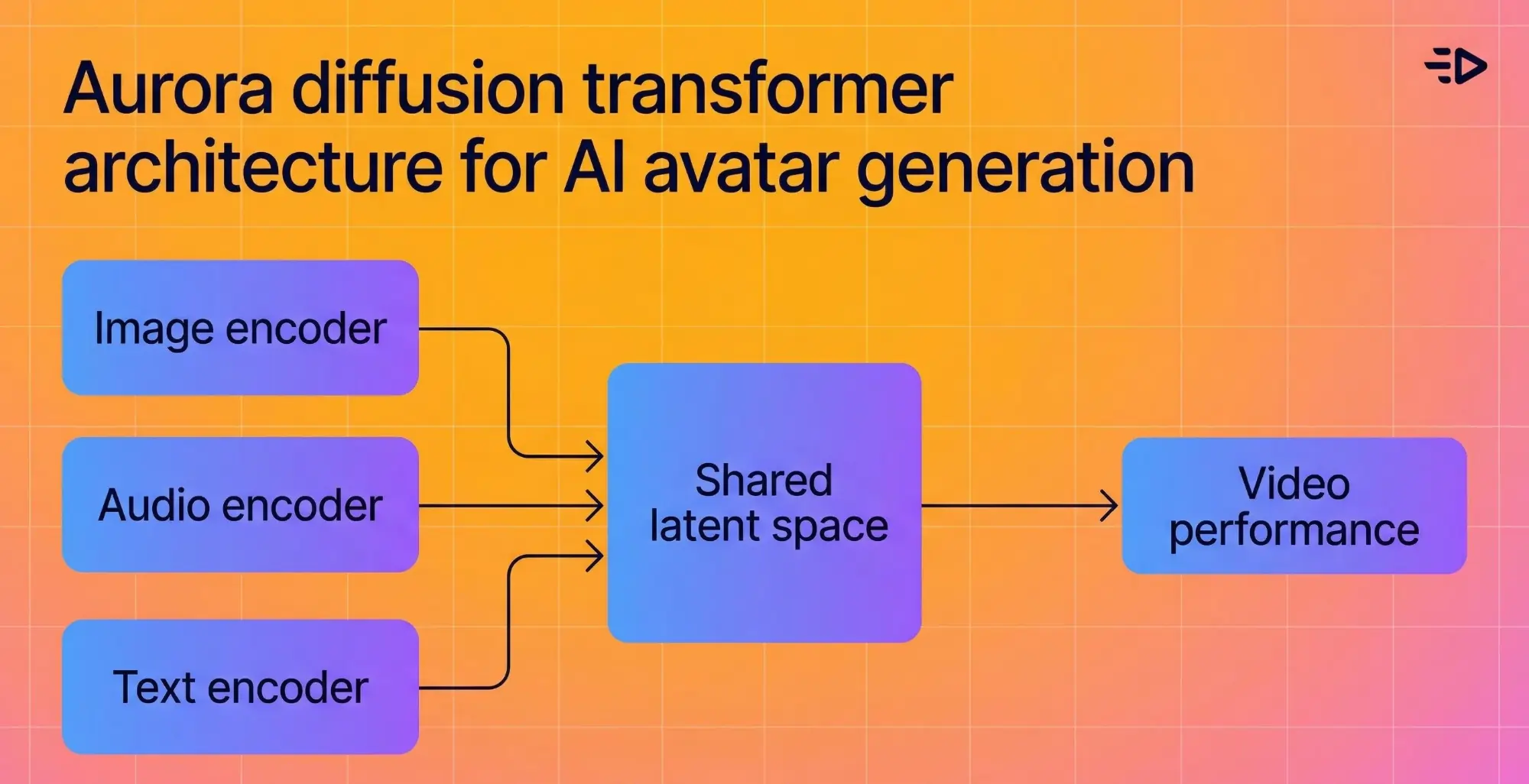

A arquitetura subjacente funde um codificador de imagem, texto e áudio em um espaço latente compartilhado, então o modelo entende o contexto emocional do que está sendo dito e reflete visualmente. Se o áudio soa entusiasmado, o avatar parece entusiasmado.

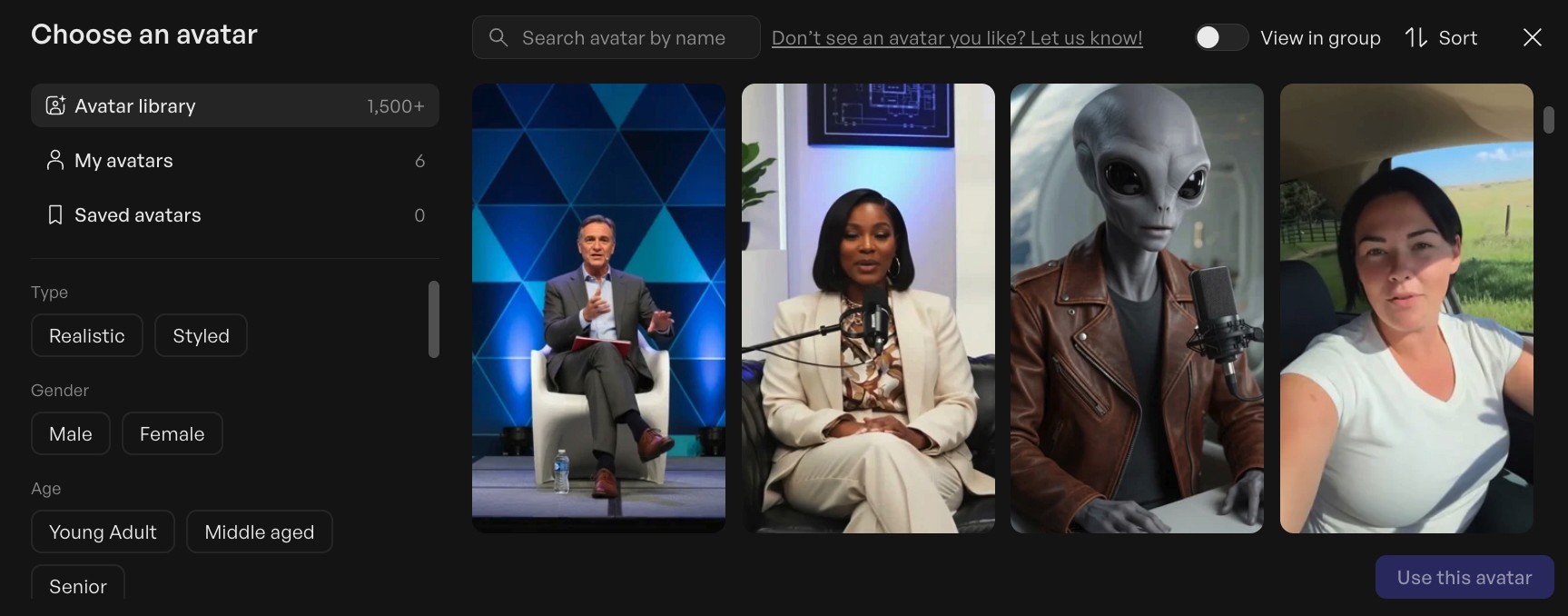

O que você pode criar com isso

Aurora suporta uma ampla gama de tipos de conteúdo além de simples cabeças falantes, tornando-se uma ferramenta poderosa para fluxos de trabalho de geração de vídeos de IA:

Demonstrações de produtos - Mostre uma pessoa segurando um produto, apontando para ele e explicando seus benefícios. Funciona para cuidados com a pele, tecnologia, bens de consumo, qualquer coisa.

Anúncios em estilo UGC - Formato selfie, leve tremor de câmera de mão, entrega casual. Difícil distinguir de conteúdo real de criadores.

Clipes de podcast - Avatar levemente de lado, como se estivesse conversando com um coapresentador, com uma expressão envolvente de conversa.

Conteúdo multilíngue - Genere o mesmo vídeo em qualquer idioma sem regravação. Aurora mantém os movimentos labiais do avatar sincronizados com o novo áudio.

Avatares cantores - Dê a eles arte de álbum e uma música, e o avatar a performa. Útil para marketing musical ou conteúdo de entretenimento.

Personagens animados - Funciona com personagens ilustrados e arte estilizada, não apenas fotos realistas.

Obtendo os melhores resultados com geração de vídeo IA

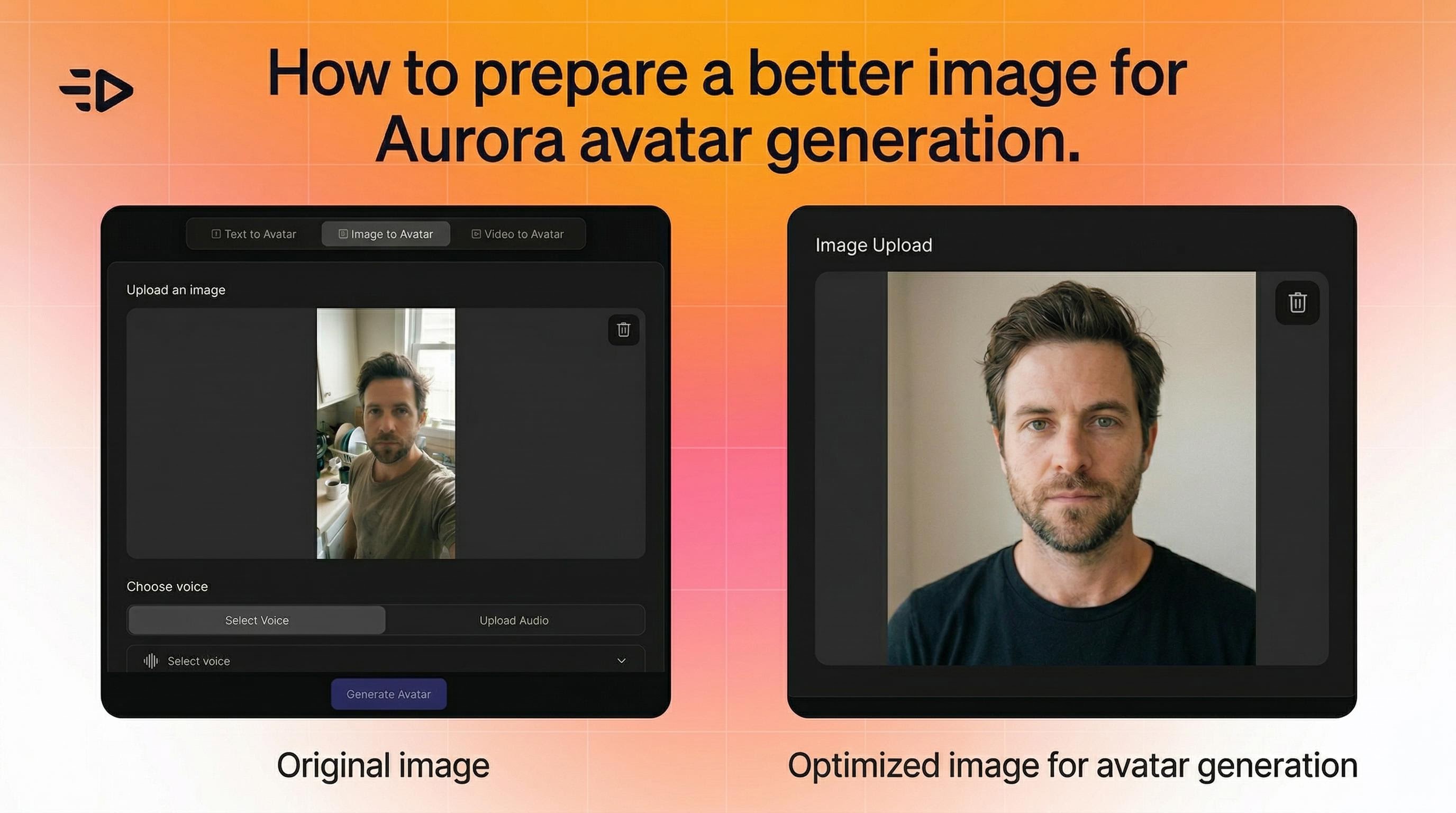

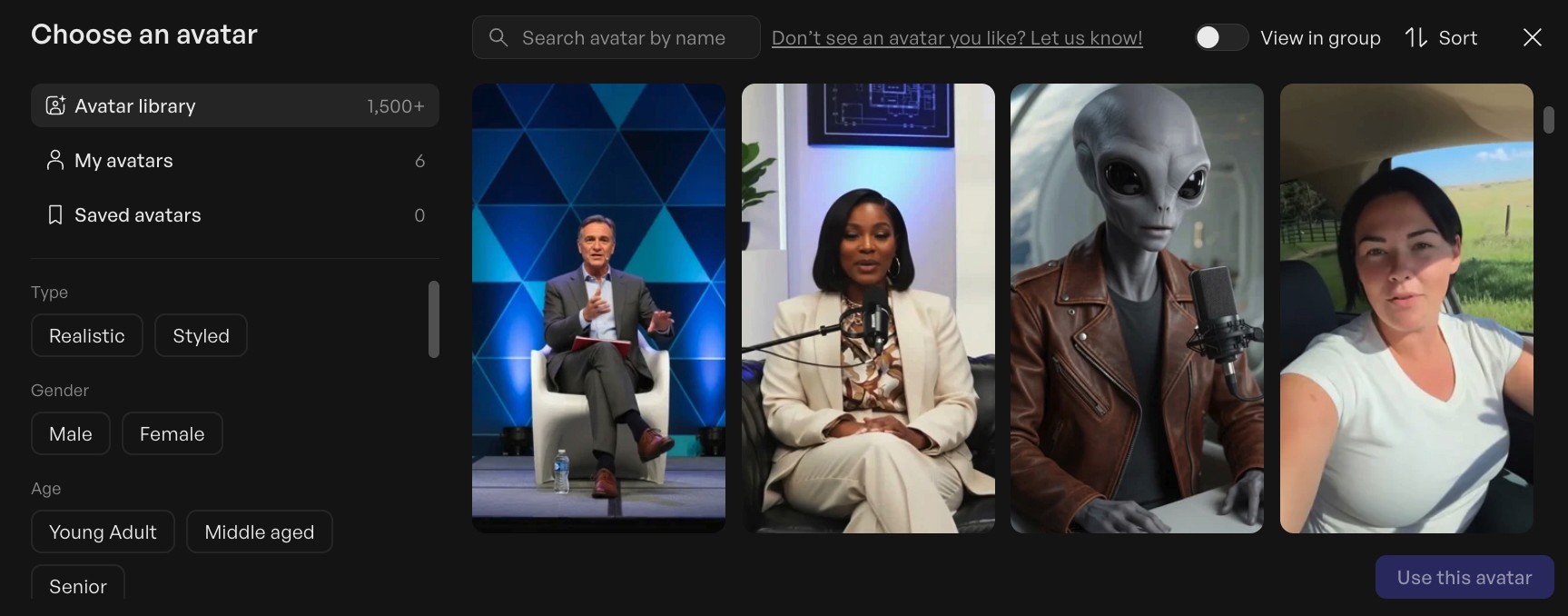

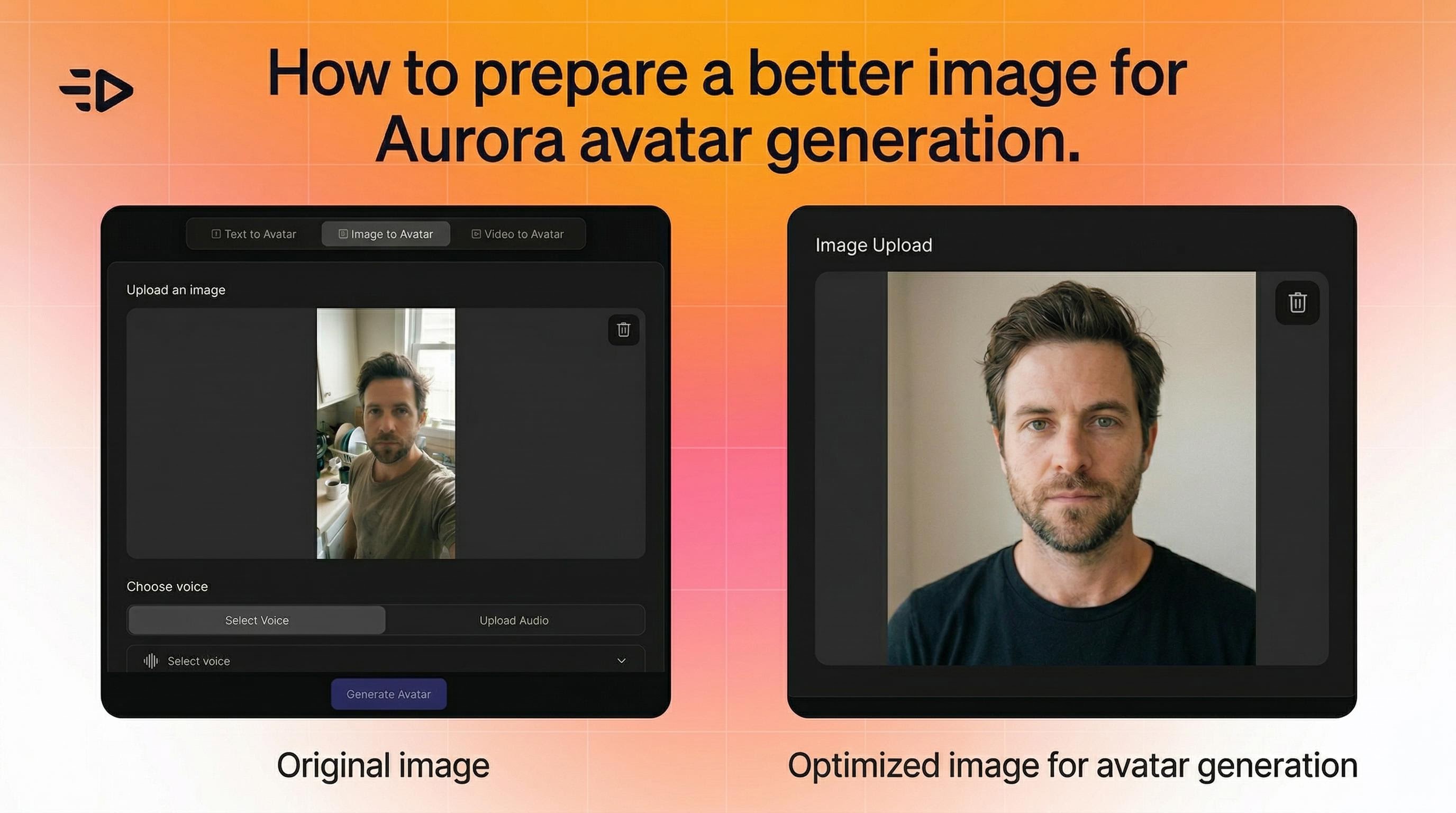

1. Comece com a imagem certa

Aurora é flexível - ela funciona com fotos, renderizações e arte de personagens. Mas algumas coisas ajudam:

O sujeito deve ser claramente visível e distinguível na imagem

Para vídeos consistentemente multissequenciais, mantenha o enquadramento semelhante em todas as imagens (ex.: todas fotos de retrato)

Se o movimento parecer não natural, tente uma imagem com uma pose mais limpa e neutra

Não há limitações estritas sobre ângulo, iluminação ou composição. Aurora ajusta-se dinamicamente.

2. Use o Voice Model V3

Isso é inegociável para resultados de qualidade. Voice Model V3 oferece a sincronia labial mais precisa e a maior gama expressiva. Modelos de voz mais antigos produzem resultados visivelmente piores.

Mantenha a velocidade da fala moderada e clara. Se a sincronia parecer ligeiramente fora do lugar, diminuir um pouco a velocidade do áudio geralmente resolve. Adicione pausas naturais entre as frases - elas dão ao avatar espaço para respirar e fazem a performance parecer mais humana.

3. Domine seu prompt

É aqui que a maioria das pessoas deixa resultados na mesa. O prompt diz à Aurora como o avatar deve se comportar - não apenas a aparência, mas como ele se move, que emoção transmite e como interage com a cena.

Use isto como seu prompt básico para qualquer vídeo padrão de cabeças falantes:

Entrevista em estúdio 4K, close médio (crop do ombro para cima). Fundo cinza claro sólido, luz suave uniforme - sem mudança de iluminação. Apresentador olha diretamente para a lente, contato visual constante. Mãos permanecem abaixo do quadro, corpo perfeitamente imóvel. Ultra nítido.

A partir daí, acrescente dicas comportamentais específicas para o seu caso de uso.

Exemplos de prompts por formato:

Caso de Uso | Dica Comportamental a Adicionar |

|---|---|

Demonstração de produto | A pessoa segurando o produto está mostrando o rótulo voltado para a câmera enquanto explica, apontando para ele de tempos em tempos. |

Cabeça falante natural | A pessoa está falando diretamente e naturalmente para a câmera com movimento respiratório no peito. Gesticulação natural e movimentos oculares explicativos. |

Podcast | A pessoa está olhando e se voltando para o lado como se estivesse conversando com alguém naquela direção, com uma expressão envolvente mostrando interesse no tema. |

Selfie UGC | A pessoa está falando em frente à câmera com uma mão não visível. A câmera tem um leve tremor como se estivesse de mão. |

Revisão de produto entusiástica | As mãos da pessoa se movem entusiasticamente tentando explicar o benefício do produto. |

Quanto mais específico você for com o tom emocional e o comportamento físico, melhor será o resultado. Prompts vagos produzem resultados genéricos.

Dica profissional: Use o GPT para combinar o cenário cinematográfico base com seu caso de uso específico. Instrua-o: "Gere um prompt Aurora otimizado para um [X] demonstração de produto" e ele combinará o enquadramento técnico com as dicas comportamentais certas automaticamente.

4. Ajuste o prompt_guidance

Aurora tem um parâmetro prompt_guidance que varia de 0 a 4. Ele controla quão estritamente o modelo segue seu prompt versus permitir variação natural.

Comece em 1 para a maioria das cenas. Dá ao modelo espaço para atuar naturalmente enquanto ainda segue as direções.

Aumente se o avatar se desviar do prompt ou não seguir as dicas comportamentais que você definiu.

Reduza se a performance parecer rígida ou mecânica.

5. Combine áudio, imagem e prompt emocionalmente

O erro mais comum: usar uma faixa de áudio energética e animada com uma imagem de rosto neutro e um prompt comportamental calmo. O modelo funde os três inputs. Se eles estiverem indo em direções diferentes, o resultado parecerá inconsistente.

Se o seu áudio é entusiasmado, seu prompt deve pedir comportamento energético e expressivo. Se for calmo e informativo, seu prompt deve refletir isso. Quanto mais alinhados esses três inputs estiverem, mais convincente será o resultado.

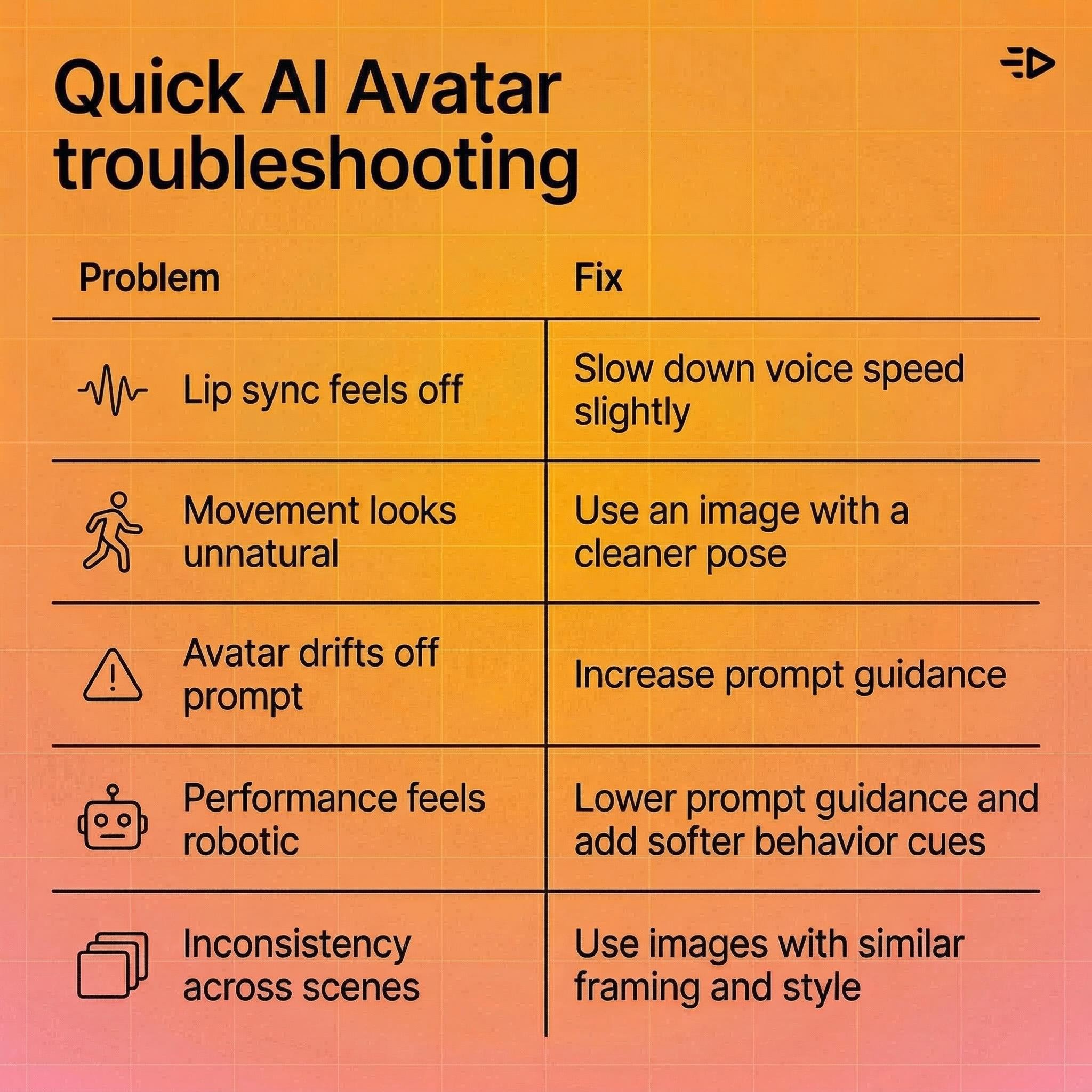

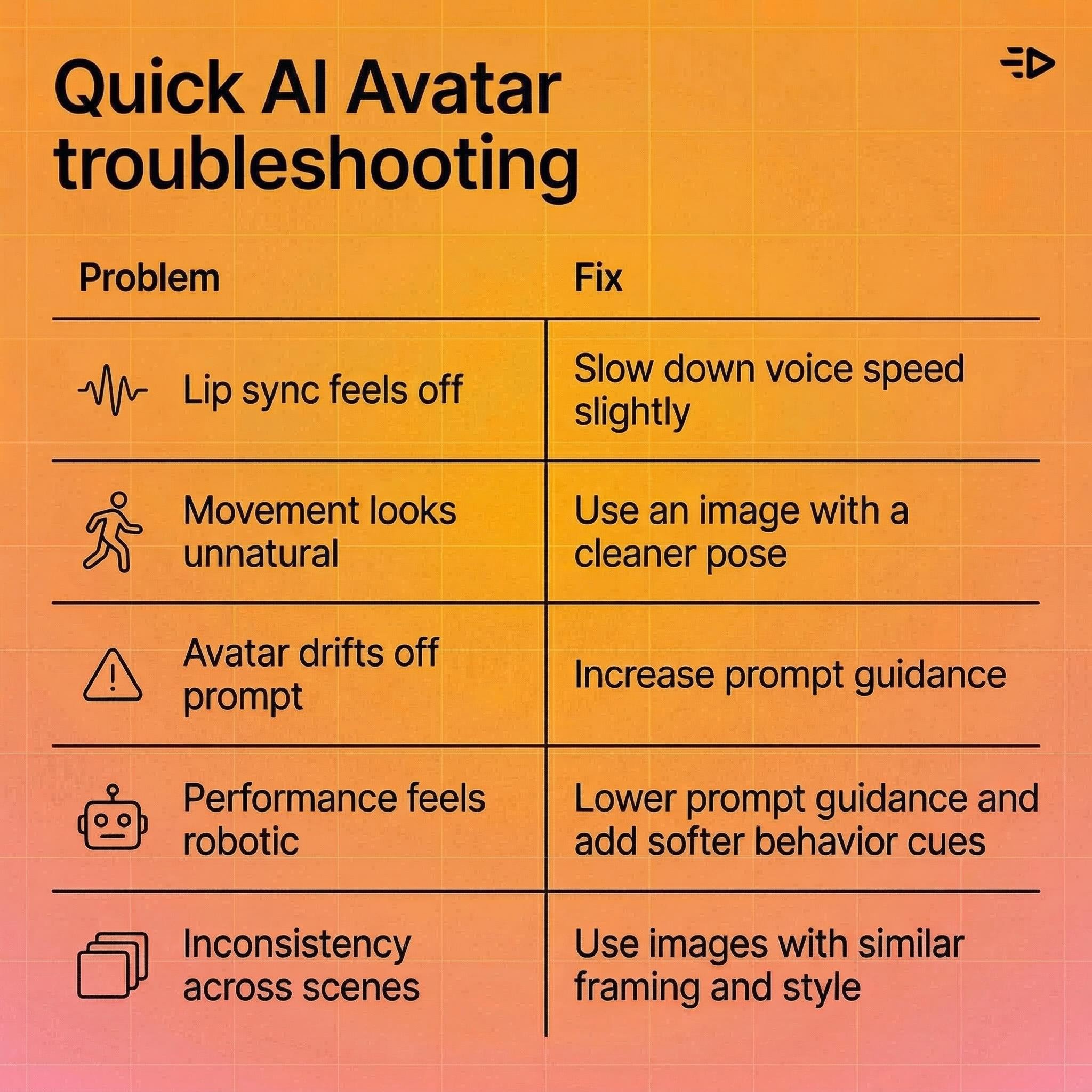

Soluções rápidas

Problema | Correção |

|---|---|

Sincronia labial parece fora | Retarde ligeiramente a velocidade da voz |

Movimento parece não natural | Tente uma imagem diferente com uma pose mais limpa |

Avatar se desvia do prompt | Aumente o prompt_guidance |

A performance parece muito robótica | Diminua o prompt_guidance; adicione dicas comportamentais mais suaves |

Inconsistência entre cenas | Use imagens com enquadramento e estilo semelhantes |

O quadro maior

Aurora representa um passo significativo à frente na geração de vídeos de IA — não porque seja uma novidade, mas porque resolve um problema real de produção. Criar vídeos de avatar de alta qualidade costumava exigir uma câmera, um estúdio, um performer e um fluxo de trabalho de pós-produção. Agora requer uma foto e um roteiro.

Para profissionais de marketing de desempenho que executam campanhas pagas, isso muda a equação no teste criativo. Para agências que gerenciam vários clientes, isso muda a economia da produção de vídeo. Para qualquer pessoa que já recusou anúncios em vídeo devido a custo ou complexidade, isso elimina a barreira completamente.

O modelo está ao vivo no Creatify, e as integrações com ElevenLabs, Runware e fal.ai significam que está cada vez mais acessível como uma capacidade autônoma para desenvolvedores e criadores que constroem em cima da infraestrutura de IA.

Uma foto. Um clipe de áudio. Um vídeo que parece ter sido gravado em um estúdio.

A maioria dos geradores de vídeo de IA te dão o vale da estranheza - bocas que se movem, olhos que não, corpos que ficam congelados como recortes de papelão. Aurora foi criada para corrigir isso.

Aurora é o modelo de difusão proprietário de Creatify (DiT) para a síntese de avatares guiada por áudio. Dê uma foto e um clipe de áudio, e ele gera um vídeo de qualidade de estúdio daquela pessoa falando, apresentando ou cantando - com expressões faciais sincronizadas, movimentos oculares naturais, respiração e gestos completos da parte superior do corpo. Não é apenas sincronia labial. É uma performance completa.

O modelo já foi integrado ao ElevenLabs, Runware e fal.ai como um dos primeiros modelos de geração de vídeo - um sinal de para onde a geração de vídeo de IA está indo.

Este guia cobre como obter os melhores resultados.

O que torna Aurora diferente

A maioria das ferramentas de cabeças falantes anima a boca e encerra por aí. Aurora trata o avatar como uma pessoa completa, estabelecendo um novo padrão para geração de vídeo de IA realista.

Aqui está o que o modelo realmente produz:

Sincronia labial que acompanha o áudio com precisão, incluindo formas sutis da boca para diferentes fonemas

Expressões faciais que correspondem ao tom vocal e à entrega emocional

Movimentos oculares - piscadas, mudanças de olhar, foco natural

Movimento da cabeça - acenos, inclinações, mudanças sutis de posição

Gestos da parte superior do corpo - movimentos das mãos, mudanças dos ombros, o tipo de movimento natural que faz uma cabeça falante parecer real em vez de robótica

Respiração - movimento do peito entre as frases

A arquitetura subjacente funde um codificador de imagem, texto e áudio em um espaço latente compartilhado, então o modelo entende o contexto emocional do que está sendo dito e reflete visualmente. Se o áudio soa entusiasmado, o avatar parece entusiasmado.

O que você pode criar com isso

Aurora suporta uma ampla gama de tipos de conteúdo além de simples cabeças falantes, tornando-se uma ferramenta poderosa para fluxos de trabalho de geração de vídeos de IA:

Demonstrações de produtos - Mostre uma pessoa segurando um produto, apontando para ele e explicando seus benefícios. Funciona para cuidados com a pele, tecnologia, bens de consumo, qualquer coisa.

Anúncios em estilo UGC - Formato selfie, leve tremor de câmera de mão, entrega casual. Difícil distinguir de conteúdo real de criadores.

Clipes de podcast - Avatar levemente de lado, como se estivesse conversando com um coapresentador, com uma expressão envolvente de conversa.

Conteúdo multilíngue - Genere o mesmo vídeo em qualquer idioma sem regravação. Aurora mantém os movimentos labiais do avatar sincronizados com o novo áudio.

Avatares cantores - Dê a eles arte de álbum e uma música, e o avatar a performa. Útil para marketing musical ou conteúdo de entretenimento.

Personagens animados - Funciona com personagens ilustrados e arte estilizada, não apenas fotos realistas.

Obtendo os melhores resultados com geração de vídeo IA

1. Comece com a imagem certa

Aurora é flexível - ela funciona com fotos, renderizações e arte de personagens. Mas algumas coisas ajudam:

O sujeito deve ser claramente visível e distinguível na imagem

Para vídeos consistentemente multissequenciais, mantenha o enquadramento semelhante em todas as imagens (ex.: todas fotos de retrato)

Se o movimento parecer não natural, tente uma imagem com uma pose mais limpa e neutra

Não há limitações estritas sobre ângulo, iluminação ou composição. Aurora ajusta-se dinamicamente.

2. Use o Voice Model V3

Isso é inegociável para resultados de qualidade. Voice Model V3 oferece a sincronia labial mais precisa e a maior gama expressiva. Modelos de voz mais antigos produzem resultados visivelmente piores.

Mantenha a velocidade da fala moderada e clara. Se a sincronia parecer ligeiramente fora do lugar, diminuir um pouco a velocidade do áudio geralmente resolve. Adicione pausas naturais entre as frases - elas dão ao avatar espaço para respirar e fazem a performance parecer mais humana.

3. Domine seu prompt

É aqui que a maioria das pessoas deixa resultados na mesa. O prompt diz à Aurora como o avatar deve se comportar - não apenas a aparência, mas como ele se move, que emoção transmite e como interage com a cena.

Use isto como seu prompt básico para qualquer vídeo padrão de cabeças falantes:

Entrevista em estúdio 4K, close médio (crop do ombro para cima). Fundo cinza claro sólido, luz suave uniforme - sem mudança de iluminação. Apresentador olha diretamente para a lente, contato visual constante. Mãos permanecem abaixo do quadro, corpo perfeitamente imóvel. Ultra nítido.

A partir daí, acrescente dicas comportamentais específicas para o seu caso de uso.

Exemplos de prompts por formato:

Caso de Uso | Dica Comportamental a Adicionar |

|---|---|

Demonstração de produto | A pessoa segurando o produto está mostrando o rótulo voltado para a câmera enquanto explica, apontando para ele de tempos em tempos. |

Cabeça falante natural | A pessoa está falando diretamente e naturalmente para a câmera com movimento respiratório no peito. Gesticulação natural e movimentos oculares explicativos. |

Podcast | A pessoa está olhando e se voltando para o lado como se estivesse conversando com alguém naquela direção, com uma expressão envolvente mostrando interesse no tema. |

Selfie UGC | A pessoa está falando em frente à câmera com uma mão não visível. A câmera tem um leve tremor como se estivesse de mão. |

Revisão de produto entusiástica | As mãos da pessoa se movem entusiasticamente tentando explicar o benefício do produto. |

Quanto mais específico você for com o tom emocional e o comportamento físico, melhor será o resultado. Prompts vagos produzem resultados genéricos.

Dica profissional: Use o GPT para combinar o cenário cinematográfico base com seu caso de uso específico. Instrua-o: "Gere um prompt Aurora otimizado para um [X] demonstração de produto" e ele combinará o enquadramento técnico com as dicas comportamentais certas automaticamente.

4. Ajuste o prompt_guidance

Aurora tem um parâmetro prompt_guidance que varia de 0 a 4. Ele controla quão estritamente o modelo segue seu prompt versus permitir variação natural.

Comece em 1 para a maioria das cenas. Dá ao modelo espaço para atuar naturalmente enquanto ainda segue as direções.

Aumente se o avatar se desviar do prompt ou não seguir as dicas comportamentais que você definiu.

Reduza se a performance parecer rígida ou mecânica.

5. Combine áudio, imagem e prompt emocionalmente

O erro mais comum: usar uma faixa de áudio energética e animada com uma imagem de rosto neutro e um prompt comportamental calmo. O modelo funde os três inputs. Se eles estiverem indo em direções diferentes, o resultado parecerá inconsistente.

Se o seu áudio é entusiasmado, seu prompt deve pedir comportamento energético e expressivo. Se for calmo e informativo, seu prompt deve refletir isso. Quanto mais alinhados esses três inputs estiverem, mais convincente será o resultado.

Soluções rápidas

Problema | Correção |

|---|---|

Sincronia labial parece fora | Retarde ligeiramente a velocidade da voz |

Movimento parece não natural | Tente uma imagem diferente com uma pose mais limpa |

Avatar se desvia do prompt | Aumente o prompt_guidance |

A performance parece muito robótica | Diminua o prompt_guidance; adicione dicas comportamentais mais suaves |

Inconsistência entre cenas | Use imagens com enquadramento e estilo semelhantes |

O quadro maior

Aurora representa um passo significativo à frente na geração de vídeos de IA — não porque seja uma novidade, mas porque resolve um problema real de produção. Criar vídeos de avatar de alta qualidade costumava exigir uma câmera, um estúdio, um performer e um fluxo de trabalho de pós-produção. Agora requer uma foto e um roteiro.

Para profissionais de marketing de desempenho que executam campanhas pagas, isso muda a equação no teste criativo. Para agências que gerenciam vários clientes, isso muda a economia da produção de vídeo. Para qualquer pessoa que já recusou anúncios em vídeo devido a custo ou complexidade, isso elimina a barreira completamente.

O modelo está ao vivo no Creatify, e as integrações com ElevenLabs, Runware e fal.ai significam que está cada vez mais acessível como uma capacidade autônoma para desenvolvedores e criadores que constroem em cima da infraestrutura de IA.

Uma foto. Um clipe de áudio. Um vídeo que parece ter sido gravado em um estúdio.

Pronto para transformar seu produto em um vídeo envolvente?